Материалы по тегу: google cloud platform

|

09.04.2025 [17:48], Руслан Авдеев

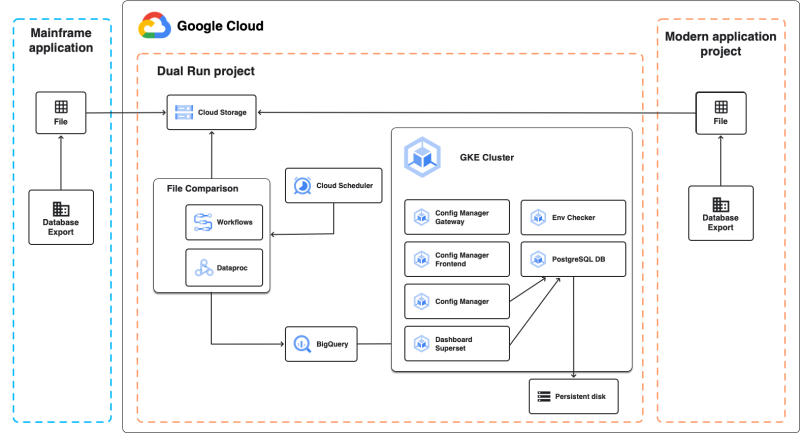

ИИ Google Gemini поможет переписать приложения для мейнфреймов и перенести их в облакоНезадолго до анонса новых мейнфреймов IBM z17 компания Google анонсировала новые ИИ-инструменты на основе моделей Gemini и других технологий для модернизации инфраструктуры и переносу нагрузок с в облако Google Cloud. Google Cloud Mainframe Assessment Tool (MAT) на основе ИИ-моделей Gemini уже доступен. Инструмент позволяет оценить и проанализировать общее состояние мейнфреймов, включая приложения и данные. Это даст возможность принимать информированные решения по оптимальной модернизации. MAT обеспечивает глубокий анализ кода, генерирует чёткие объяснения его работы, автоматизирует создание документации и др. Это позволяет ускорить понимание кода мейнфреймов и стимулирует процесс модернизации. Google Cloud Mainframe Rewrite на основе моделей Gemini позволяет модернизировать приложения для мейнфреймов (инструмент доступен в превью-режиме). Он помогает разработчикам переосмыслить и преобразовать код для мейнфреймов, переписав его на современные языки программирования вроде Java и C#. Mainframe Rewrite предлагает IDE для модернизации кода, тестирования и развёртывания модернизированных приложений в Google Cloud. Наконец, чтобы снизить риски, возникающие при модернизации, предлагается инструмент Google Cloud Dual Run для глубокого тестирования, сертификации и оценки модернизированных приложений. Инструмент позволяет проверить корректность, полноту и производительность модернизированного кода в ходе миграции и до того, как новое приложение заменит старое. Dual Run сравнивает данные, выдаваемые старой и новой системами, для поиска отличий. Имеются и дополнительные инструменты, разработанные партнёрами Google. Так, Mechanical Orchard предлагает платформу для быстро переписывания приложений на COBOL на современные языки, включая Java, Python и др., без изменения бизнес-логики. Решение позволяет «пошагово» переписывать фрагменты приложений с помощью систем генеративного ИИ с сохранением функциональности и тестировать корректность их работы. Основная цель — создать для облака функциональный эквивалент устаревших решений. Кроме того, в рамках новой программы Google Mainframe Modernization with Gen AI Accelerator компания привлекла Accenture, EPAM и Thoughtworks, которые помогут организациям мигрировать с мейнфреймов. На первом этапе производится анализ кода с помощью MAT и Gemini. На втором реализуется пилотный проект с проверкой работоспособности нового кода. На третьем осуществляется полномасштабная миграция в облако. Первые клиенты могут бесплатно (без учёта расходов на Google Cloud) оценить решения в течение 4-8 недель. Мейнфреймы ещё рано списывать со счетов. Согласно данным опроса Kyndryl 500 топ-менеджеров ИТ-индустрии, многие организации интегрируют мейнфреймы с публичными и частными облачными платформами и совершенствуют свои программы модернизации, перемещая некоторые рабочие нагрузки с мейнфреймов или обновляя их.

27.03.2025 [12:02], Руслан Авдеев

Желающие купить американский бизнес TikTok потянулись за поддержкой к облачным операторам США

bytedance

google cloud platform

hardware

microsoft azure

oracle cloud platform

tiktok

облако

слухи

сша

Компании, рассматривающие возможность покупки американского подразделения социальной сети TikTok, обращаются за помощью к Microsoft и Google. Это делается в преддверии приближающегося «дедлайна» продажи, установленного на 5 апреля, сообщает The Information. По данным издания, ссылающегося на людей, «участвовавших в переговорах», некоторые компании, включая небольшие группы частных инвесторов, претендующие на покупку TikTok, но не обладающие собственными облачными ресурсами, ведут переговоры с Microsoft и Google об использовании их облачной инфраструктуры для поддержания работы сервиса в США. С 2022 года американский сегмент TikTok эксклюзивно использует облако Oracle — со времён первого президентства Дональда Трампа (Donald Trump), который требовал, чтобы ByteDance продала свой бизнес в США местным компаниям. Утверждается, что в тот период Oracle была близка к покупке подразделения, но после того, как пост президента занял Джо Байден (Joe Biden), необходимость продажи временно пересмотрели. Ранее китайская ByteDance, владеющая TikTok, рассчитывала, что размещение данных в облаке Oracle позволит спасти бизнес и снимет опасения американских властей по поводу угрозы национальной безопасности. Однако этого не произошло. Как сообщает Datacenter Dynamics, в декабре 2024 года TikTok не удалось выиграть апелляцию по делу о запрете деятельности социальной сети в США, и приложение даже было временно отключено для американских пользователей — ещё во время президентства Байдена. Однако пришедший к власти Дональд Трамп подписал указ, отсрочивший запрет на 75 дней. По некоторым данным, интерес к покупке американского сегмента TikTok проявили Microsoft и Oracle. Крайний срок продажи — всего через несколько дней, 5 апреля. Однако достоверно неизвестно, кто станет покупателем, если сделка вообще состоится. Как сообщает The Information, вполне вероятно, что Oracle продолжит предоставлять хостинг TikTok в случае продажи. Однако информация о переговорах с Google и Microsoft может свидетельствовать о том, что некоторые прежние соглашения с Oracle могут оказаться под вопросом. Сами облачные операторы ситуацию не комментируют. Примечательно, что TikTok и так является клиентом Google, Microsoft и AWS, которые предоставляют социальной сети услуги по хранению данных. В Европе массивы данных TikTok разделены между Green Mountain в Норвегии и ирландским ЦОД, вероятно, на территории Echelon. Ранее в марте TikTok обязался увеличить инвестиции в дата-центры в Таиланде до $8,8 млрд, но как теперь будут связаны американский и глобальный сегменты, пока неизвестно.

11.03.2025 [12:21], Руслан Авдеев

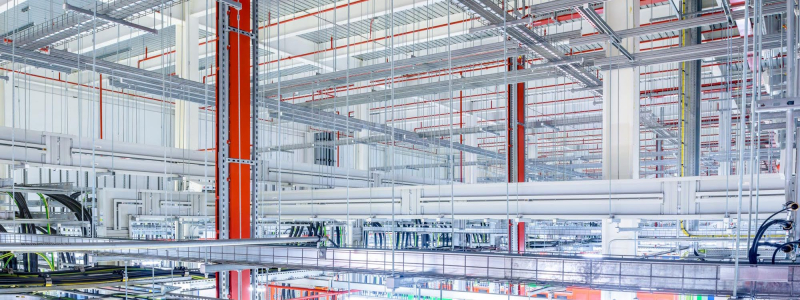

Google Cloud запустила облачный регион в Швеции — одним из ключевых клиентов станет IKEAGoogle объявила о создании очередного облачного региона на территории Швеции. Это уже 42-й регион Google Cloud в мире и 13—й — в Европе, сообщает пресс-служба компании. Одним из её партнёров-клиентов в этом проекте стала IKEA, объявившая, что она «в восторге» от сотрудничества с Google Cloud и что она разделяет приверженность IT-гиганта к инновациям в Швеции. Поддерживает новый проект и шведский сервис Spotify, который сотрудничает с Google уже с десяток лет. Регион europe-north2 обеспечит шведские бизнесы, организации и отдельных клиентов платформой для ИИ, машинного обучения и аналитики данных, а низкая задержка доступа сделает использование сервисов комфортным. Так, Шведская правительственная Комиссия по ИИ (AI Comission) недавно опубликовала план, который включает создание «ИИ-фрабрики» для государственного сектора. Создание региона также позволяет решить вопрос с требованиями законодательства по обеспечению суверенитета данных и размещению данных жителей на территории страны. Обещаны шифрование данных во время хранения и передачи, детализированный контроль доступа, передовые системы обнаружения угроз и т.п. Новый облачный регион Google с 2026 году будет как минимум на 99% обеспечен безуглеродной энергией (CFE) благодаря экологически чистой энергосистеме страны. Google также подчеркивает свои усилия для устойчивого развития, в том числе упоминая первые соглашения о покупке экологически чистой энергии (PPA) в Швеции с 2013 года и поддержку проектов ветровой энергетики мощностью более 700 МВт. Регион находится Авесте (Avesta) в лене Даларна (Dalarnas län) недалеко от Стокгольма. Регион включает три зоны доступности, однако расширение до как минимум трёх отдельных ЦОД запланировано на будущее. При этом Google инвестирует не только в данный облачный регион, но и в цифровую экосистему Швеции вообще, совместно с местными партнёрами вроде Devoteam и Tietoevry Tech Services. Организовано сотрудничество с местными бизнесами, образовательными учреждениями и государственными организациями для создания процветающей экосистемы. Google заявила, что намерена и далее продолжать инвестиции в Швецию, сотрудничать с бизнесом и другими организациями. Не дремлют и конкуренты. Летом прошлого года Microsoft сообщила, что вложит $3,2 млрд в ИИ-инфраструктуру и облако в Швеции, а в конце августа CoreWeave пообещала, что развернёт в Швеции крупнейший в Европе ИИ-кластер NVIDIA Blackwell.

03.03.2025 [15:23], Руслан Авдеев

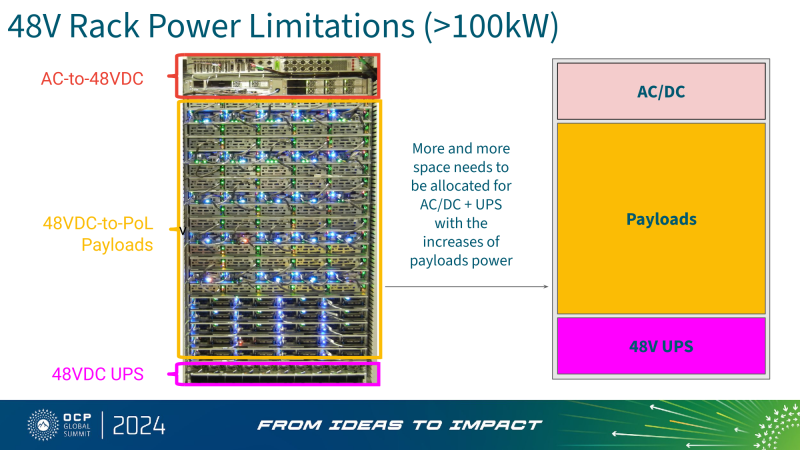

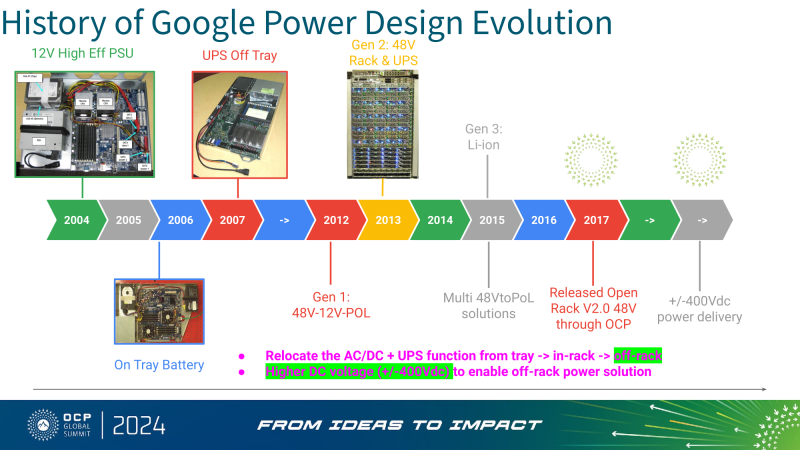

Google развернула уже 100 млн литий-ионных ячеек в своих ЦОДСистемы энергоснабжения дата-центров во многом зависят от аккумуляторов в составе ИБП. Участники рынка ЦОД активно инвестируют в создание аккумуляторных систем — не так давно число используемых Li-Ion элементов в дата-центрах Google по всему миру достигло 100 млн шт., сообщает пресс-служба компании. В Google используются системы электропитания с 48 В постоянного тока (48Vdc), причём ИБП интегрированы непосредственно в стойки. Такая распределённая архитектура обладает двумя ключевыми преимуществами: область возможного сбоя ИБП ограничивается одной стойкой; нет дополнительной точки отказа между ИБП и серверами. Такой подход снижает общую стоимость владения (TCO), поскольку ИБП масштабируется вместе с инфраструктурой, благодаря чему уменьшаются затраты на начальном этапе внедрения, говорит компания. Размещение батарей на DC-шине вместе с серверами исключает потери энергии, связанные с промежуточными преобразованиями переменного тока (AC) в постоянный (DC), положительно влияя на общую эффективность системы. В 2016 году Google открыла спецификации своей системы электропитания стоек, включая спецификации для литий-ионных BBU, в рамках Open Compute Project (OCP). Кроме того, Li-Ion аккумуляторы вдвое долговечнее и вдвое мощнее свинцово-кислотных элементов, применявшихся ранее. Таким образом, переход с одних на другие означает, что теперь можно использовать меньше батарей, что также положительно влияет на экологичность ЦОД, говорит Google. В Google отмечают, что развернуть 100 млн Li-Ion элементов можно только благодаря подходу «безопасность прежде всего», принятому в компании. Основным риском для такого типа элементов является возможность неуправляемого нагрева, т. н. «теплового разгона» в случае, если с ними некорректно обращаются, чрезмерно заряжают или не охлаждают должным образом. В результате могут случаться пожары, и хотя такое бывает редко, огонь очень трудно погасить из-за выделения большого количества тепла и риска «цепной реакции» воспламенения соседних элементов. Для использования большого «парка» АКБ в Google применяют метод тестирования UL9540A (стандарт, разработанный для оценки безопасности энергосистем, включая аккумуляторы) и проводит строгие испытания литий-ионных блоков BBU. В результате Google успешно получила от регуляторов разрешения на использование BBU даже в Азиатско-Тихоокеанском регионе, где действуют самые жёсткие правила. Сейчас в Google изучают возможность использования больших энергохранилищ (BESS). Безопасность аккумуляторов — не праздный вопрос. Пожары в дата-центрах вообще случаются не так уж редко, а во многих случаях причиной служат именно инциденты с аккумуляторами. За примерами не надо далеко ходить: один из крупнейших в мире сбоев ЦОД южнокорейской площадки Kakao произошёл именно из-за перегрева и возгорания литий-ионных аккумуляторов SK On, что привело к пожару. В сентябре 2024 года из-за возгорания Li-Ion элементов ИБП пострадал сингапурский ЦОД Digital Realty. В 2023 году эксперты Uptime Institute предупреждали о возможной опасности использования Li-Ion элементов в дата-центрах, поскольку они подвержены повышенному риску возгорания.

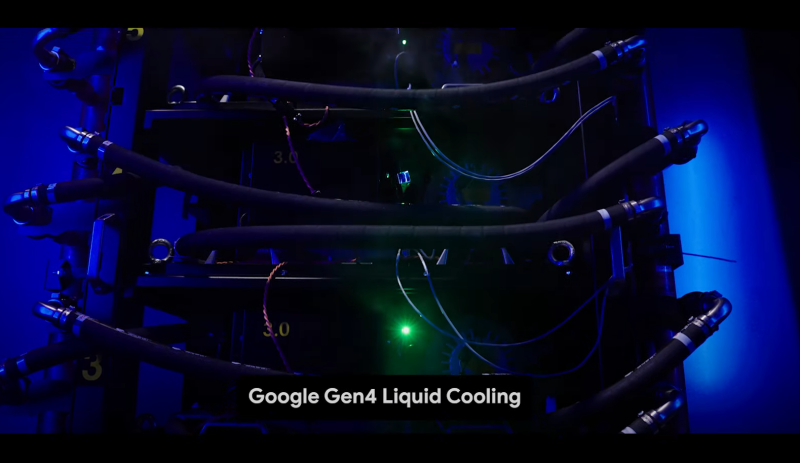

22.02.2025 [22:45], Сергей Карасёв

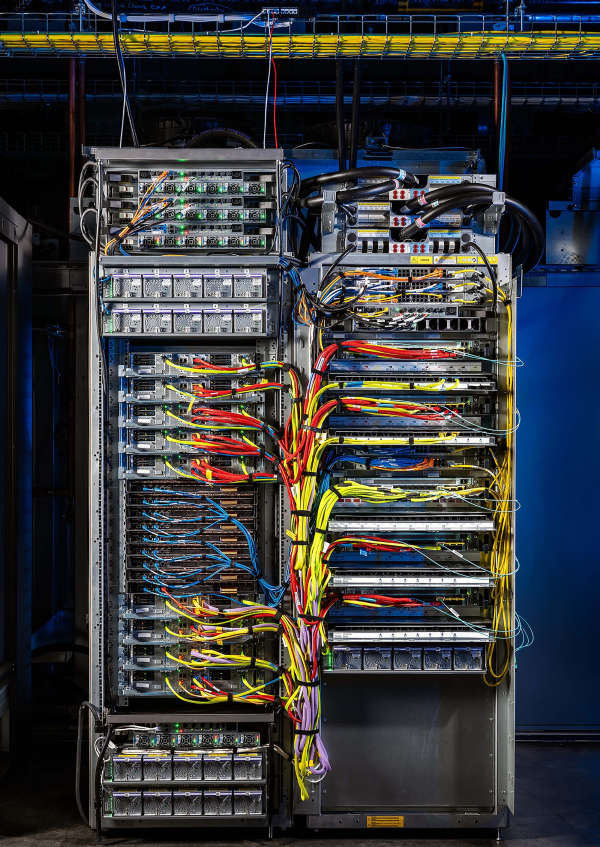

В облаке Google Cloud появились инстансы A4X на базе суперускорителей NVIDIA GB200 NVL72Облачная платформа Google Cloud объявила о запуске виртуальных машин A4 с ускорителями NVIDIA B200 и A4X на основе суперускорителей NVIDIA GB200 NVL72 поколения Blackwell. Эти инстансы ориентированы на ресурсоёмкие приложения ИИ. По заявлениям Google, виртуальные машины A4 обеспечивают высокий уровень производительности при работе с ИИ-моделями на различных архитектурах. Инстансы подходят для таких рабочих нагрузок, как обучение и тонкая настройка. В свою очередь, экземпляры A4X специально созданы для обучения и обслуживания самых требовательных и сверхмасштабных задач ИИ, включая большие языковые модели (LLM) с наиболее ёмкими контекстными окнами и «рассуждающие» модели. Суперускорители GB200 NVL72 объединяют в одной стойке 72 чипа B200 и 36 процессоров Grace. Применяются шина NVLink 5 и инфраструктура жидкостного охлаждения Google третьего поколения. Каждая система GB200 NVL72 обеспечивает быстродействие до 1,44 Эфлопс в режиме FP4 и до 720 Пфлопс в режиме FP8. По заявлениям Google, достигается четырёхкратное увеличение производительности при обучении LLM по сравнению с виртуальными машинами A3 на базе ускорителей NVIDIA H100. Инстансы A4X допускают масштабирование до десятков тысяч графических процессоров Blackwell. Говорится об интеграции с сервисами хранения Cloud Storage FUSE, Parallelstore и Hyperdisk ML, что обеспечивает доступ к данным с малой задержкой (менее 1 мс) и высокую пропускную способность. Новые виртуальные машины будут развёрнуты в различных регионах Google Cloud. Нужно отметить, что ранее о запуске общедоступных инстансов на базе NVIDIA GB200 NVL200 объявила компания CoreWeave, предоставляющая облачные услуги для ИИ-задач. Скоро эти суперускорители станут доступны и в облаке Lambda Labs.

05.02.2025 [23:04], Владимир Мироненко

Рост Google Cloud замедлился, но ради ИИ компания готова потратить $75 млрд на серверы и ЦОД в 2025 годуХолдинг Alphabet, материнская структура Google, сообщил финансовые результаты IV квартала и всего 2024 финансового года, завершившегося 31 декабря. По итогам 2024 года чистая прибыль Alphabet впервые превысила отметку в $100 млрд, составив $100,12 млрд при выручке в $ 350,02 млрд, выросшей год к году на 14 %. Результаты Alphabet оказались ниже прогнозов Уолл-стрит, поэтому акции холдинга упали на 9 % во вторник на внебиржевых торгах. Консолидированная выручка Alphabet в IV квартале 2024 года выросла на 12 % в годовом исчислении до $96,47 млрд США, что, как утверждает холдинг, отражает устойчивую динамику во всём бизнесе. Вместе с тем показатель оказался ниже консенсус-прогноза аналитиков, опрошенных LSEG, полагавших, что выручка должна быть выше — в пределах $96,56 млрд. Также аналитиков разочаровал квартальный доход облачного подразделения Google Cloud, составивший $11,96 млрд, что на 30 % выше прошлогоднего результата, но ниже консенсус-прогноза в размере $12,19 млрд экспертов, опрошенных StreetAccount. Чистая прибыль Alphabet выросла на 28 % до $26,54 млрд, превысив прогноз аналитиков LSEG в размере $26,0 млрд, при этом чистая прибыль на акцию выросла на 31 % до $2,15, что выше ожиданий аналитиков, опрошенных LSEG, в размере $2,13 на акцию. Alphabet объявил, что выделит $75 млрд на капитальные затраты в 2025 году по сравнению с $52,5 млрд в прошлом году. Это тоже вызвало вопросы у инвесторов, поскольку разница более чем в $22 млрд могла быть добавлена к прибыли холдинга. При этом другие гиперскейлеры также увеличат траты на инфраструктуру: Meta✴ готова вложить $60–65 млрд, а Microsoft — $80 млрд. В свою очередь, руководство Alphabet настаивает на том, что инвестиции оправданны, поскольку Google Cloud сейчас не в состоянии удовлетворить спрос на ИИ-технологии. Финансовый директор Alphabet Анат Ашкенази (Anat Ashkenazi) заявила в ходе онлайн-конференции с аналитиками, что холдинг прилагает все усилия, чтобы развернуть больше мощностей и справиться со спросом. По её словам, эти цифры в первую очередь отражат инвестиции в техническую инфраструктуру, причем крупнейшим компонентом являются инвестиции в серверы, за которыми следуют ЦОД «для поддержки роста бизнеса Google Services, Google Cloud и Google DeepMind». «Мы находимся в ситуации с дефицитом предложения при высоком спросе, и усердно работаем над тем, чтобы ввести больше мощностей в эксплуатацию», — отметила Ашкенази. Она сообщила, что темпы роста облачного подразделения Google могут измениться в 2025 году, поскольку компания продолжает закупать всё больше оборудования и строить больше объектов. По её словам, капитальные затраты Alphabet в I квартале составят от $16 до $18 млрд, и квартальный показатель изменится в течение года. Это выше прогноза аналитиков FactSet в размере $14,3 млрд. Капитальные затраты Alphabet за IV квартал составили $14 млрд превысив ожидания Уолл-стрит в $13,26 млрд, согласно StreetAccount. Сомнения инвесторов в правильности инвестиционной политики Alphabet усилились после анонса китайским стартапом DeepSeek ряда ИИ-моделей, расходы на обучение которых оказались гораздо ниже, чем у Google. «Неутешительные результаты Cloud говорят о том, что импульс, основанный на ИИ, может начать ослабевать как раз в то время, как стратегия Google с закрытой моделью ставится под сомнение DeepSeek», — отметила Эвелин Митчелл-Вольф (Evelyn Mitchell-Wolf), аналитик исследовательской компании Emarketer. Что касается остальных подразделений Alphabet, то рост доходов от рекламы Google составил 10,6 % по сравнению с 11 % годом ранее. Доходы от поиска выросли год к году на 12,0 % до $54,03 млрд по сравнению с ростом на 12,7 % в IV квартале 2023 года. Доходы от рекламы на YouTube выросли на 13,8 % до $10,47 млрд по сравнению с 15,5 % роста годом ранее, а рост всех доходов сервисов (Google Services) составил 10,2 % по сравнению с 12, % годом ранее.

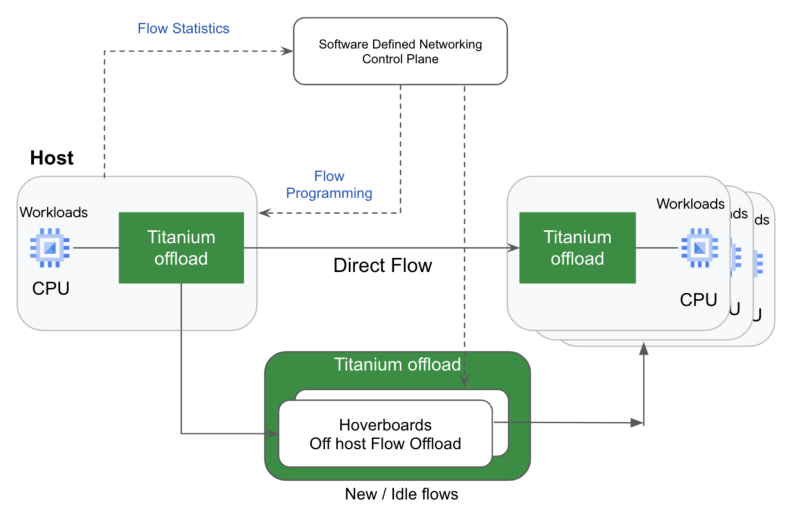

04.02.2025 [12:03], Владимир Мироненко

Google представила превью инстансов A4 на базе ускорителей NVIDIA B200Google объявила о предварительной доступности инстансов A4 на базе новых ускорителей B200 от NVIDIA с архитектурой архитектуры Blackwell. Инстанс A4 обеспечивает значительный прирост производительности по сравнению с предшественником A3. A4 используют системы NVIDIA HGX B200 с восемью ускорителями, объединёнными посредством NVIDIA NVLink. Как отметила компания, NVIDIA HGX B200 предлагает в 2,25 раза большую пиковую вычислительную мощность и в 2,25 раза большую ёмкость HBM по сравнению с инстансами A3, что делает A4 универсальным вариантом для обучения и тонкой настройки широкого спектра архитектур моделей, в то время как увеличенная вычислительная мощность и ёмкость HBM делают их подходящим вариантом для обработки нагрузок с низкой задержкой. Инстансы A4 интегрируют инфраструктурные инновации Google, включая улучшенные сетевые возможности с использованием адаптеров Titanium ML, поддержку управляемой службы кластера Google Kubernetes Engine и доступ через полностью управляемую унифицированную платформу Vertex AI для разработки и использования генеративного ИИ. Также используется открытое ПО: в дополнение к использованию фреймворка МО PyTorch и CUDA компания сотрудничает с NVIDIA для оптимизации JAX и XLA. Как отметила компания, эффективное масштабирование обучения модели ИИ требует точной и масштабируемой оркестрации ресурсов инфраструктуры. При этом рабочие нагрузки часто охватывают тысячи виртуальных машин. Специализированная платформа Hypercompute Cluster позволит развёртывать и управлять большими кластерами виртуальных машин A4 с вычислениями, хранением и сетями как единым целым, обеспечивая при этом высокую производительность и устойчивость для больших распределённых рабочих нагрузок.

17.01.2025 [00:06], Владимир Мироненко

Google представила инстансы C4A с фирменными Titanium SSD и Arm-процессорами AxiomGoogle объявила о доступности инстансов C4A с кастомными накопителями Titanium SSD, специально разработанными для облачных нагрузок, требующих обработки данных в реальном времени, с низкой задержкой и высокой пропускной способностью хранилища. Titanium SSD в составе инстансов C4A, построенных на Arm-процессорах Axion собственной разработки, обеспечивают производительность до 2,4 млн IOPS на операциях случайного чтения, до 10,4 ГиБ/с пропускной способности чтения и до 35 % более низкую задержку доступа по сравнению с SSD предыдущего поколения. Titanium SSD — первое поколение SSD Google, интегрированных с DPU Titanium, обеспечивающей повышение производительности выполнения приложений за счет разгрузки операций по работе с сетью и хранилищем, а также управления. Семейство инстансов C4A на базе процессоров Google Axion обеспечивает до 65 % выше производительность и до 60 % лучше энергоэффективность по сравнению с аналогичными инстансами текущего поколения на базе архитектуры x86. Как сообщает Google, C4A с Titanium SSD обеспечивают самое выгодное в отрасли соотношение цены и производительности для широкого спектра совместимых с Arm универсальных рабочих нагрузок, таких как высокопроизводительные базы данных, аналитические системы, поисковые и рабочие нагрузки, которые выигрывают от кеширования и использования локального хранилища. Конфигурация C4A с Titanium SSD включает до 72 vCPU, 576 Гбайт памяти и 6 Тбайт локального хранилища в двух вариантах — Standard (4 Гбайт RAM на vCPU) и High-memory (8 Гбайт/vCPU). Сетевое подключение C4A имеет пропускную способностью до 50 Гбит/с или до 100 Гбит/с. Инстансы также поддерживают новейшее поколение хранилища Balanced и Extreme Hyperdisk с производительностью до 350 тыс. IOPS и пропускной способностью до 5 Гбайт/с на виртуальную машину. Клиенты Google Cloud могут использовать C4A с Titanium SSD для сервисов Compute Engine, Google Kubernetes Engine (GKE), Batch, Dataproc и т.д. Инстансы C4A теперь также доступны в версии превью в Dataflow с поддержкой Cloud SQL, AlloyDB и других сервисов, которые появятся в ближайшее время. C4A доступны по запросу, в качестве спотовых и зарезервированных инстансов, со скидками за обязательное использование (CUD) и FlexCUD в регионах us-central1 (Айова), us-east4 (Вирджиния), us-east1 (Южная Каролина), europe-west1 (Бельгия), europe-west4 (Нидерланды), europe-west3 (Франкфурт), europe-west2 (Лондон) и asia-southeast1 (Сингапур). Вскоре они появятся в других регионах.

02.12.2024 [21:29], Руслан Авдеев

Google предлагала европейским облакам миллионы евро для продолжения борьбы с MicrosoftСогласно закрытым документам, тексты которых попали в распоряжение The Register, в своё время Google Cloud предлагала «финансовые стимулы» на сотни миллионов евро для организации европейских облачных провайдеров CISPE, жаловавшихся регуляторам на Microsoft. Как свидетельствуют источники, представитель Google общался как с руководством группы, так и со всему участниками организации CISPE. В ходе одной из презентаций предлагалось создать для участников организации Фонд инноваций в объёме €4 млн, который использовался бы для финансирования проектов и лицензионных сборов участников CISPE, для поддержки инноваций в открытых облачных экосистемах. На каждого участника пришлось бы порядка €100 тыс. — сейчас в CISPE 36 членов, в том числе Oxya, Leaseweb, UpCloud и даже AWS, единственная «неевропейская» компания. Ещё в июле группа включала лишь 27 компаний. Дополнительно Google предложила выделить CISPE ещё €10 млн в качестве «ресурсов на участие и членство». Наконец, Google предложила участникам CISPE кредиты на использование Google Distributed Cloud в размере €100 млн в течение пяти лет. При этом в презентации подчёркивалось, что фонд инноваций и программная платформа будут доступны действующим членам CISPE с условием «сохранения организацией неограниченных возможностей в продвижении принципов справедливого ПО».

Источник изображения: David Clode/unsplash.com Предполагается, что предложение было сделано с целью убедить участников CISPE не отказываться от жалоб на Microsoft, связанных с политикой лицензирования последней, которая делает использование продуктов редмондского гиганта в чужих облаках неоправданно дорогим. Жалобу подали в ноябре 2022 года, но позже Microsoft небезвозмездно уговорила большинство участников CISPE (кроме гиперскейлеров) отказаться от претензий — о попытках Google остановить этот процесс сообщалось ранее. Правда, в самой Google заявляют, что жалоба и финансовые стимулы с её стороны никак не связаны. Несмотря на отчаянные попытки Google, CISPE приняла решение отказаться от тяжб с Microsoft. По слухам, последняя потратила на улаживание претензий €10–€30 млн. При этом членам CISPE станет доступно решение Azure Local (Stack HCI) для развёртывания облака на базе собственной инфраструктуры. Источники в CISPE сообщают, что устали бороться с Microsoft и хотят просто решить проблему лицензирования, а не начинать новую войну, навязываемую Google. Microsoft, вполне возможно, тоже так или иначе заплатила участникам CISPE за отказ от преследования. Сама Google создала Open Cloud Coalition (OCC), в которую входят преимущественно небольшие британские облачные операторы и один испанский провайдер. Microsoft уже назвала группу «искусственным газоном, созданным Google» для дискредитации компании и введения регуляторов в заблуждение. OCC заявляет, что выступает за открытые стандарты и против ограничительного лицензирования и иных барьеров, мешающих конкуренции и инновациям — в Google обеспокоены тем, что массовый переход в облако Microsoft фактически лишает её клиентов. OCC можно использовать для лоббирования и жалоб в Управлении по конкуренции и рынкам Великобритании (CMA). В Евросоюзе Google также подавала жалобу на антиконкурентные практики и доминирование Microsoft в сфере облачного ПО в сентябре. Впрочем, большую часть облачного рынка Европы и так занимают AWS, Microsoft и Google. По данным Synergy Research, во II квартале 2024 года расходы на облачный рынок в Европе составили $16 млрд. На долю AWS пришлось 32 % рынка, Microsoft — 26 %, а на Google — 15 %. Крупнейшие конкуренты Microsoft называют политику лицензирования её ПО несправедливой. Так, за использование Windows Server вне Azure обходится вчетверо дороже. Тем не менее, по словам представителя CISPE, общавшегося с The Register, участники организации проголосовали за предложения Microsoft, оптимальные для европейского облачного сектора. Ранее представитель Google уклонился от прямого ответа на вопрос о том, предлагала ли компания заплатить участникам CISPE за продолжение тяжбы с Microsoft. Ранее топ-менеджмент Google официально заявлял, что оплата не предлагалась.

03.11.2024 [12:15], Сергей Карасёв

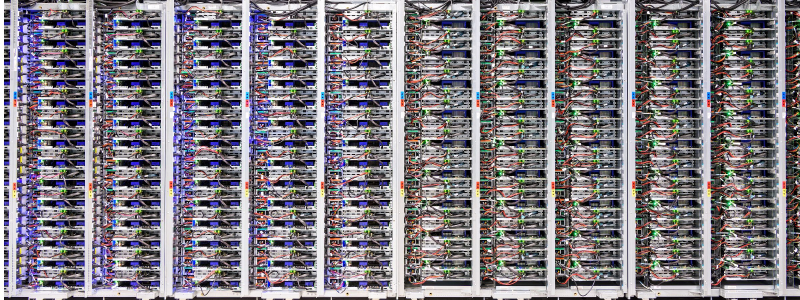

Google Cloud представила инстансы A3 Ultra с ускорителями NVIDIA H200 и готовится развернуть суперускорители GB200 NVL72Компания Google объявила о том, что в составе её облачной платформы в скором времени станут доступны инстансы A3 Ultra на базе ускорителей NVIDIA H200. Новые виртуальные машины предназначены для ресурсоёмких нагрузок, связанных с ИИ, включая обучение больших языковых моделей (LLM). Напомним, в августе 2023 года Google анонсировала инстансы A3 с ускорителями NVIDIA H100. Позднее дебютировали виртуальные машины A3 Mega с поддержкой конфиденциальных вычислений. А до конца текущего месяца клиенты получат доступ к A3 Ultra со значительно более высокой производительностью. Представленные инстансы построены на серверах с новыми DPU Titanium ML, оптимизированными для высокопроизводительных облачных рабочих нагрузок ИИ. Заявленная пропускная способность RDMA-соединений GPU↔GPU достигает 3,2 Тбит/с (RoCE). Задействована фирменная платформа Google Jupiter с оптической коммутацией. По сравнению с A3 Mega виртуальные машины A3 Ultra обеспечивают следующие преимущества:

Инстансы A3 Ultra будут доступны через Google Kubernetes Engine (GKE). Кроме того, виртуальные машины войдут в состав Hypercompute Cluster — специализированной платформы, объединяющей передовые ИИ-технологии Google Cloud. Отмечается также, что в начале 2025 года Google развернёт системы на базе NVIDIA GB200 NVL72. Ранее Google демонстрировала собственный вариант этого суперускорителя. |

|